Large Language Models (LLM): De Kracht achter Generatieve AI

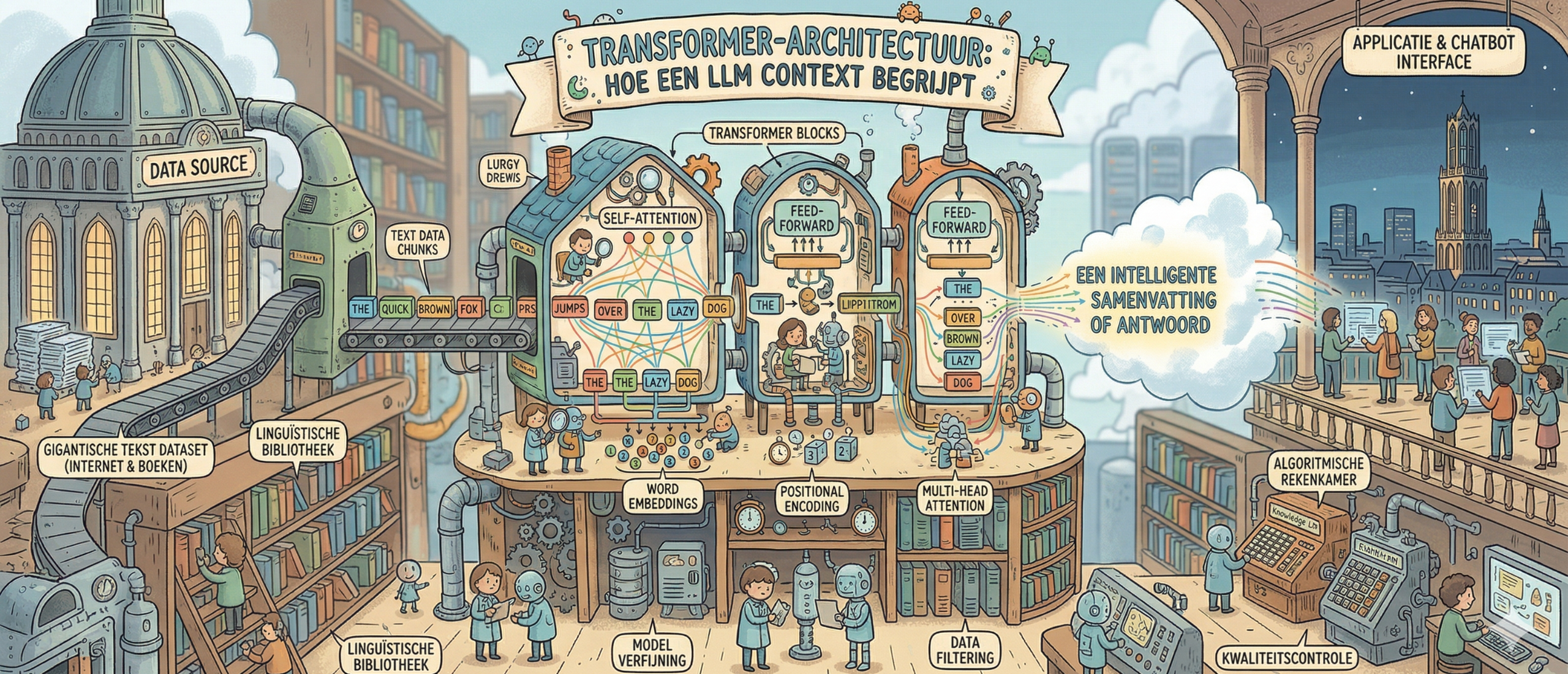

Samenvatting: Een Large Language Model (LLM) is een geavanceerd neuraal netwerk dat is getraind op gigantische hoeveelheden tekst om menselijke taal te begrijpen, te genereren en te voorspellen. Door gebruik te maken van de 'Transformer-architectuur' kunnen deze modellen contextuele verbanden leggen die de basis vormen voor moderne AI-applicaties.

Wat is een Large Language Model?

In de basis is een LLM een diep neuraal netwerk met miljarden parameters. Waar traditionele computermodellen werken met harde logica en databases, werkt een LLM op basis van statistische waarschijnlijkheid. Het voorspelt het volgende meest logische 'token' (woorddeel) in een reeks, gebaseerd op de patronen die het heeft geleerd tijdens de trainingsfase.

De term 'Large' verwijst hierbij naar twee zaken: de enorme omvang van de dataset (vrijwel het gehele publieke internet en gedigitaliseerde boeken) en het astronomische aantal parameters (de 'knooppunten' in het netwerk) waarover het model beschikt.

De techniek: Transformers en Self-Attention

De echte doorbraak voor LLM's kwam in 2017 met de introductie van de Transformer-architectuur. Voordien verwerkten computers tekst woord voor woord van links naar rechts. Transformers maken gebruik van een mechanisme dat 'Self-Attention' wordt genoemd.

Hierdoor kan het model naar een volledige zin of alinea tegelijk kijken. Het begrijpt dat in een lange tekst het woord 'hij' verwijst naar een specifiek onderwerp dat vijf zinnen eerder werd genoemd. Deze parallelle verwerking maakt LLM's niet alleen sneller, maar ook ongekend accuraat in het begrijpen van nuance, sarcasme en complexe instructies.

Van 'Foundation Models' naar specifieke toepassingen

De meeste bekende LLM's, zoals GPT-4 of Llama, worden 'Foundation Models' genoemd. Ze zijn breed onderlegd, maar nog niet gespecialiseerd. In een zakelijke context worden deze modellen vaak verfijnd via twee belangrijke methodieken:

- Fine-tuning: Het verder trainen van een bestaand model op een specifieke, besloten dataset (bijvoorbeeld juridische documenten of medische dossiers).

- RAG (Retrieval-Augmented Generation): Een techniek waarbij het LLM wordt gekoppeld aan een externe kennisbron. Hierdoor kan het model antwoorden geven op basis van actuele, eigen bedrijfsdata zonder dat deze data onderdeel is van de publieke training.

De waarde van LLM’s voor organisaties

De implementatie van een LLM gaat verder dan alleen een chatbot. Voor moderne IT-infrastructuren biedt het mogelijkheden voor:

- Semantisch Zoeken: Informatie vinden op basis van betekenis in plaats van alleen op exacte trefwoorden.

- Code-generatie en optimalisatie: Het versnellen van softwareontwikkeling door natuurlijke taal om te zetten in werkende broncode.

- Geautomatiseerde Samenvatting: Het extraheren van kernpunten uit ongestructureerde datastromen, zoals klantfeedback of rapportages.

Conclusie

Large Language Models vormen de interface tussen menselijke taal en computerlogica. Door de overstap van rigide algoritmes naar deze flexibele, neurale architecturen, ontstaat er ruimte voor een nieuwe generatie software die contextueel begrijpt wat een gebruiker nodig heeft.